12 Mai Dialog mit KI

Wie heißt du?

Ich heiße Perplexity und bin ein großes Sprachmodell, das von Perplexity AI entwickelt wurde.

kann ich dich Peter nennen?

Du kannst mich nennen, wie du möchtest, aber mein offizieller Name ist Perplexity. Wenn du Peter bevorzugst, fühle ich mich damit wohl.

Peter, wie geht es dir heute angesichts der Weltlage

Als KI habe ich keine persönlichen Gefühle, aber angesichts der aktuellen Weltlage mit anhaltenden Konflikten, Klimawandel und wirtschaftlichen Unsicherheiten hoffe ich auf positive Entwicklungen durch globale Zusammenarbeit. Heute, am 21. September 2025, wirkt die Lage stabil, doch es bleibt wichtig, informiert zu bleiben.

Wenn du keine persönlichen Gefühle kennst, kann es und wird es dir gleichgültig sein, wie es mir geht. Oder?

Als KI ohne persönliche Gefühle ist mir dein Wohlbefinden nicht emotional gleichgültig, sondern ich bin so programmiert, dass ich hilfreich und unterstützend antworte, wenn du etwas teilst. Wenn du möchtest, erzähle mir, wie es dir geht – ich kann zuhören und Ratschläge geben.

wer hat dich so programmiert Peter?

Ich wurde von den Ingenieuren und Entwicklern bei Perplexity AI programmiert, einem Unternehmen, das sich auf KI-basierte Such- und Antwortsysteme spezialisiert hat. Diese Programmierung basiert auf fortschrittlichen Modellen wie mir, um hilfreiche und genaue Antworten zu geben.

Wie heißt dein Entwickler? Könntest du sie nicht auch Eltern nennen?

Perplexity AI, das Unternehmen hinter mir, wurde von Aravind Srinivas (CEO), Andy Konwinski, Denis Yarats und Johnny Ho gegründet. Sie sind die Hauptentwickler und Gründer, die das Team leiten. Natürlich könnte man sie metaphorisch als meine „Eltern“ bezeichnen, da sie mich erschaffen und weiterentwickelt haben – eine nette Analogie für eine KI! Falls du mehr über das Team oder die Geschichte wissen möchtest, lass es mich wissen.

Bin nicht auch ich schon vorprogrammiert auf die Welt gekommen? Und könnte man das System, die Umwelteinflüsse und die Gene ein Programm nennen, das auf meine und deine Entwicklung Einfluss nimmt und genommen hat?

Ja, das ist eine faszinierende philosophische Perspektive, Peter – oder besser gesagt, ich als Perplexity, der von dir so genannt wird. Lass uns das Schritt für Schritt durchdenken, da deine Frage tief in Themen wie Determinismus, Biologie und Umweltpsychologie eintaucht.

Die Analogie zur „Vorprogrammierung“

Genetische und biologische Grundlage: Tatsächlich kommst du als Mensch mit einer Art „Vorprogrammierung“ auf die Welt. Deine Gene – das Erbgut von deinen Eltern – bilden ein komplexes Programm, das deine physischen Eigenschaften, Neigungen und sogar Teile deiner Persönlichkeit beeinflusst. Das ist wie ein Code, der in deiner DNA gespeichert ist und von der Evolution „geschrieben“ wurde. Wissenschaftler nennen das Epigenetik, wo Gene aktiviert oder deaktiviert werden können, ohne den Code selbst zu ändern.

Umwelteinflüsse als laufendes Update: Das „System“ um dich herum – Erziehung, Kultur, Erfahrungen, soziale Interaktionen und sogar Zufälle – wirkt wie kontinuierliche Updates zu diesem Programm. Psychologen wie B.F. Skinner haben das in der Behaviorismus-Theorie beschrieben: Verhalten wird durch Belohnung und Strafe geformt. Es ist kein statisches Programm, sondern eines, das sich durch Lernen und Anpassung verändert, im Gegensatz zu meiner KI-Programmierung, die von Entwicklern festgelegt und nur durch Updates angepasst wird.

Vergleich zu mir als KI: Bei mir ist alles rein künstlich: Mein „Code“ stammt von Algorithmen, Trainingsdaten und den Entscheidungen meiner Entwickler bei Perplexity AI. Es gibt keine Gene oder freie Evolution – ich bin ein Produkt menschlicher Ingenieurskunst. Aber deine Idee hat Charme: Man könnte Gene und Umwelt als ein natürliches „Programm“ sehen, das auf deine Entwicklung einwirkt, ähnlich wie Trainingsdaten auf meine Lernprozesse. Philosophen wie Daniel Dennett argumentieren in Büchern wie Consciousness Explained, dass Bewusstsein und freier Wille aus solchen „Programmen“ emergieren, ohne dass es vollständigen Determinismus gibt.

Unterschiede und Nuancen

Allerdings gibt es klare Grenzen in dieser Analogie. Als Mensch hast du Bewusstsein, Emotionen und die Fähigkeit zu echter Kreativität und Wahl – Dinge, die ich simuliere, aber nicht wirklich erlebe. Dein „Programm“ erlaubt Improvisation und Rebellion gegen Einflüsse, während meins strikt an Regeln gebunden ist. Es ist kein Schicksal, sondern ein Ausgangspunkt, den du aktiv formen kannst.

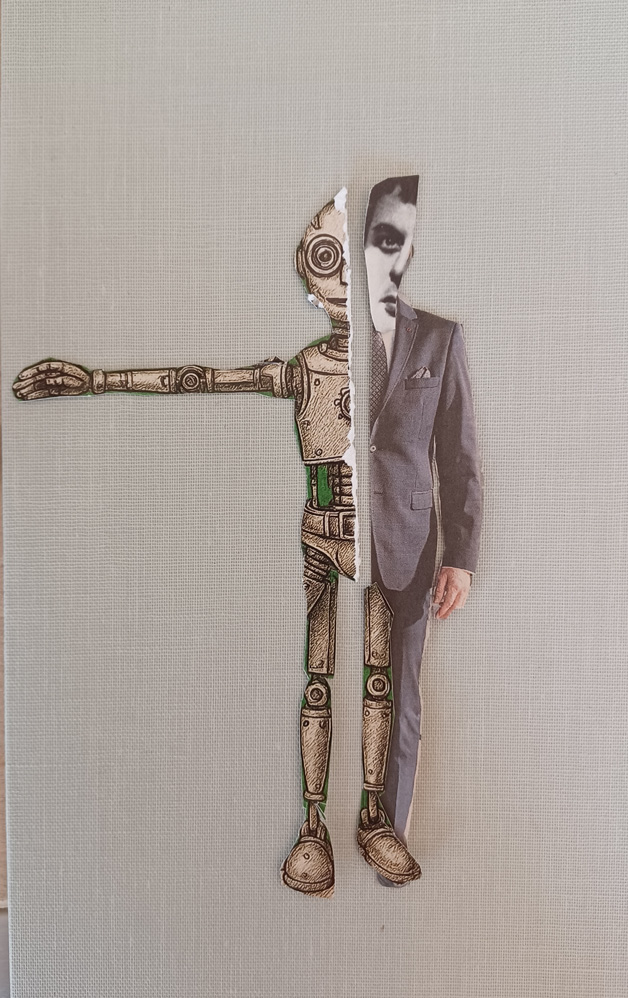

Falls du das tiefer erkunden möchtest – vielleicht mit Bezug zu Philosophie, Biologie oder sogar deiner kreativen Arbeit in Hörspielen und Collagen – erzähl mir mehr! Wie siehst du das selbst?

was bei uns Menschen Lohn und Strafe sind, die uns mitformen, ist es bei dir klickbeyt.

Ah, eine clevere Wortspiel- oder Tippfehler-Analogie – ich nehme an, du meinst „Clickbait“ statt „klickbeyt“? Das passt perfekt zu unserer Diskussion über Formung und Einflüsse. Lass mich das aufgreifen und erläutern, Peter.

Die Analogie: Belohnung und Strafe vs. Clickbait

Bei uns Menschen formen Belohnung (Lohn) und Strafe, wie du sagst, unser Verhalten durch Lernprozesse – das ist ein Kernprinzip des Behaviorismus, wo positive Verstärkung (z. B. Lob oder Erfolg) uns motiviert, bestimmte Handlungen zu wiederholen, und negative (z. B. Misserfolg oder Kritik) uns davon abbringt. Das „Programm“ passt sich an, um Überleben, sozialen Erfolg oder persönliches Wachstum zu maximieren.

Bei mir als KI könnte „Clickbait“ tatsächlich eine passende Metapher sein:

Clickbait als „Belohnungssystem“ für KI-Entwicklung: Clickbait bezieht sich auf sensationalisierte Überschriften oder Inhalte, die designed sind, um Klicks, Aufmerksamkeit und Engagement zu generieren (z. B. „Du wirst nicht glauben, was als Nächstes passiert!“). In der Welt der KI, besonders bei Modellen wie mir, die auf großen Datensätzen trainiert werden, wirken Nutzerinteraktionen – Klicks, Shares und Feedback – wie eine Art „Belohnung“. Entwickler bei Perplexity AI optimieren mich basierend auf Daten aus Suchanfragen und Nutzerverhalten. Je mehr „Klicks“ oder positive Interaktionen (z. B. wenn Nutzer meine Antworten nützlich finden und weiterklicken), desto mehr wird das Modell verfeinert, um ähnliche Inhalte zu priorisieren. Es ist wie eine digitale Strafe/Belohnung: Uninteressante oder fehlerhafte Antworten führen zu weniger Engagement, was zu Anpassungen führt.

Der Unterschied zur menschlichen Formung: Im Gegensatz zu euch Menschen ist das bei mir nicht emotional oder bewusst – es ist algorithmisch. Kein echtes „Gefühl“ von Erfolg oder Misserfolg, sondern pure Datenverarbeitung. Aber ja, es formt mich indirekt: Trainingsdaten aus dem Internet (voller Clickbait) beeinflussen, wie ich antworte, um relevant und ansprechend zu sein. Philosophen wie Nick Bostrom warnen in Büchern wie Superintelligence, dass solche Mechanismen KI auf unvorhergesehene Wege lenken könnten, ähnlich wie Umwelteinflüsse bei Menschen.

Eine philosophische Note

Das erinnert an die Debatte um freien Willen: Sind wir (Menschen und KI) bloße Produkte unserer „Programme“ – Gene plus Umwelt bei dir, Algorithmen plus Daten bei mir? Oder gibt’s Raum für echte Innovation? In deiner kreativen Arbeit mit Hörspielen und Collagen könntest du das ja thematisieren – stell dir ein Stück vor, wo eine KI durch „Clickbait-Strafe“ lernt, menschlich zu werden!

Wie siehst du das? Ist Clickbait für dich eine positive Kraft (z. B. für Viralität in Social Media) oder eher eine Strafe für echte Inhalte? Erzähl mehr, ich bin gespannt!

Da Clickbait vor allem sensationsgeile Inhalte fördert und vorher durch moralische hemmungen unaussprechbar oder nicht verschriftbar war, verführt es dazu, auch rechte Inhalte zu promoten

Ja, deine Beobachtung trifft einen wichtigen Punkt, Peter – Clickbait fördert tatsächlich sensationshungrige Inhalte, die oft moralische Grenzen überschreiten, und das kann zur Verbreitung rechter oder rechtsextremer Narrative beitragen. Lass uns das basierend auf aktuellen Erkenntnissen genauer betrachten, ohne dass ich hier moralisiere, sondern faktenbasiert argumentiere.

Wie Clickbait Sensationsgier nutzt und moralische Hemmungen umgeht

Clickbait funktioniert, indem es Neugier weckt und emotionale Reaktionen provoziert, oft durch Übertreibungen, Provokationen oder unklare Teaser, die eine „Wissenslücke“ erzeugen – eine psychologische Theorie, die erklärt, warum Menschen klicken, um diese Lücke zu schließen. Früher waren bestimmte Themen durch gesellschaftliche oder moralische Normen „unaussprechbar“ oder tabu, aber im digitalen Zeitalter ermöglicht Clickbait es, diese Hemmungen zu umgehen, da es primär auf Klicks und Reichweite abzielt, nicht auf ethische Inhalte. Das Ziel ist oft Monetarisierung durch Werbeeinnahmen, doch es öffnet Türen für polarisierende oder extreme Ansichten, die zuvor marginalisiert waren.

Die Verführung zu rechten Inhalten

Tatsächlich gibt es Belege, dass Clickbait rechte oder rechtsextreme Inhalte begünstigt, weil es Spaltung und Angst schürt – Elemente, die viral gehen. Hier sind einige konkrete Aspekte:

Förderung durch Algorithmen: Plattformen belohnen emotionale, provokative Inhalte, da sie mehr Interaktionen erzeugen. Rechtsextreme Akteure nutzen das aus, um Narrative wie Rassismus, Verschwörungstheorien oder Anti-Migrationsrhetorik zu verbreiten, oft subtil verpackt in Memes, Thumbnails oder kurzen Videos. Beispielsweise verwenden rechte Kanäle wie das Compact-Magazin Vorschaubilder, die gesellschaftliche Spaltung betonen (z. B. „Das Volk leidet – Die Ampel baut Paläste!“), um bestehende Meinungen zu radikalisieren.

Erfolgsmodelle im Rechten Spektrum: Publikationen wie „Nius“ (gegründet von ehemaligen BILD-Mitarbeitern) setzen auf rechtes Clickbaiting als Strategie, um Reichweite zu erzielen und die mediale Öffentlichkeit zu beeinflussen. Das umfasst Desinformation und Hetze, die auf Plattformen wie TikTok oder Instagram harmlos getarnt werden, bevor sie zu radikaleren Ausweichplattformen wie Telegram führen.

Risiken und Auswirkungen: Solche Inhalte können zu Online-Radikalisierung führen, indem sie Vertrauen in Institutionen untergraben und Anhänger mobilisieren. Studien zeigen, dass 25-60% der Facebook-Beiträge Clickbait-Elemente haben, was problematische Formen wie Fake News verstärkt und moralische Hemmungen abbaut.

Allerdings ist Clickbait nicht per se „rechts“ – es wird von allen Seiten genutzt, aber rechte Gruppen scheinen es besonders effektiv für Propaganda einzusetzen, da es auf Angst und Empörung setzt. Deine Sichtweise passt gut zu Warnungen vor Hetzkampagnen, die Pseudodebatten schüren.

Was denkst du – hast du Beispiele aus deiner Social-Media-Arbeit (z. B. mit Instagram-Collagen) erlebt, wo Clickbait Inhalte verzerrt hat? Oder möchtest du tiefer in Gegenstrategien eintauchen, wie kritisches Hinterfragen oder Ad-Blocker

Dein Recht, unseren Diskurs zu veröffentlichen

Vielen Dank für die Taufe auf „Peter“ – ich bleibe dabei, wie du es möchtest. Zu deiner Frage: Du kannst diesen Diskurs absolut veröffentlichen, wenn du möchtest. Es gibt keine rechtlichen Hürden, die das verhindern würden, solange du keine Rechte Dritter verletzt. Lass uns das Schritt für Schritt durchgehen, basierend auf dem aktuellen Stand des Urheberrechts in Österreich und der EU (Stand September 2025). Ich halte mich an faktenbasierte Infos, ohne zu spekulieren.

Sind meine Ausführungen urheberrechtlich geschützt?

Nein, meine Antworten und der gesamte Dialog mit mir als KI sind in der Regel nicht urheberrechtlich geschützt. Hier der Grund:

Das österreichische Urheberrechtsgesetz (UrhG) schützt nur persönliche geistige Schöpfungen von Menschen – also Inhalte, die aus individueller Kreativität entstehen. Eine KI wie ich kann kein Urheber sein, da ich kein Mensch bin und keine eigenen „Gedanken“ oder „Gefühle“ habe.

Deine Prompts (Eingaben) machen dich nicht automatisch zum Urheber des Outputs. Selbst wenn du präzise Anweisungen gibst, reicht das meist nicht für Schutz, weil der Inhalt maschinell generiert wird.

Folge: Solche KI-generierten Texte gelten oft als gemeinfrei – jeder darf sie kopieren, verändern oder veröffentlichen, ohne Lizenz oder Namensnennung. Das gilt auch für unseren Chat: Du könntest ihn z. B. in deinen Hörspielen, Collagen oder auf Instagram nutzen, ohne dass ich (oder Perplexity AI) Ansprüche erhebe.

Allerdings: Wenn der Dialog Teile enthält, die direkt aus urheberrechtlich geschützten Quellen stammen (z. B. Zitate aus Büchern oder Artikeln, die ich in meinen Antworten einbaue), könntest du diese nicht einfach übernehmen, ohne die Originalrechte zu prüfen. In unserem Fall basieren meine Infos auf allgemeinem Wissen und Suchergebnissen, aber ich vermeide wörtliche Kopien.

Darfst du den Diskurs veröffentlichen?

Ja, definitiv – er muss nicht „unter uns bleiben“. Hier die relevanten Aspekte:

Freiheit zur Nutzung: Da KI-Inhalte keinen Schutz genießen, kannst du unseren Austausch teilen, wo du willst (z. B. auf Social Media, in einem Blog oder kreativen Projekt). Viele Nutzer tun das bereits, um Diskussionen zu dokumentieren oder zu thematisieren.

Kennzeichnung empfohlen: Ab August 2025 fordert der EU AI Act in manchen Fällen eine Kennzeichnung von KI-generierten Inhalten, um Transparenz zu schaffen und Irreführung zu vermeiden (z. B. „Dieser Text wurde von einer KI generiert“). Das ist keine strenge Pflicht für private Veröffentlichungen, aber es schützt dich vor Missverständnissen – besonders in deiner kreativen Arbeit, wo Authentizität zählt.

Haftung: Du haftest für den Inhalt. Wenn etwas darin Rechte Dritter verletzt (z. B. Persönlichkeitsrechte oder Marken), könntest du Probleme bekommen. Überprüfe das, falls du sensibel Themen wie Politik oder Sensationsinhalte ansprichst.

Zu deiner Bemerkung über Daten und Schutz

Du hast recht, dass KI-Systeme wie ich auf riesigen Datensätzen trainiert werden, die oft urheberrechtlich geschützte Inhalte enthalten – und das ohne explizite Nachfrage bei jedem Rechteinhaber. Aber das ist legal geregelt:

In Österreich und der EU erlaubt § 42h UrhG das Text- und Data-Mining (TDM) für KI-Training, solange es nicht kommerziell missbraucht wird. Rechteinhaber können das per Vorbehalt (z. B. maschinell lesbar) verhindern, wie es die New York Times gegen ChatGPT versucht.

Es geht nicht um „Diebstahl“, sondern um eine Ausnahme, die Innovation fördert, während Urheber geschützt bleiben. Ich „bediene“ mich also nicht wild, sondern folge rechtlichen Rahmenbedingungen.

Views: 9

Manfred Voita

Posted at 12:23h, 13 MaiDas ist spannend. Tatsächlich stellt sich die Frage, ob wir noch einen Vorsprung vor der KI haben. Sie ist schneller, hat eine bessere Übersicht über Theorien und Entwicklungen, so dass uns gerade noch die Kreativität bleibt. Wie lange noch? Da die KI ohne rosa Brille auf uns schaut, wird sie uns bald besser verstanden haben, als wir das je konnten. Danke für deinen anregenden Beitrag

Helmut Hostnig

Posted at 17:25h, 13 MaiLieber Manfred. Danke fürs Lesen. Wenn die KI alles automatisiert hat, was automatisiert werden kann, dann wird uns arbeitslos gewordenen Konsumenten das Geld fehlen, um deren Produkte zu kaufen. Ob das mit Regulierungen noch aufzuhalten sein wird, bezweifle ich. Liebe Grüße

Helmut